ЁЁЁЁ6.15 ЙигкЪТЮёЯрЙиаХЯЂВПЗжФкШн

ЁЁЁЁЪТЮёЕФЯьгІЪБМфЪЧЮвУЧЦНЪБОГЃЙизЂЕФвЛЯюадФмжИБъЃЌГ§ДЫжЎЭтЃЌдкНсЙћИХвЊаХЯЂЭМБэжаЃЌФњЛЙЛсОГЃПДЕНЪТЮёЕФзюаЁжЕЃЈMinimumЃЉЁЂЦНОљжЕЃЈAverageЃЉЁЂзюДѓжЕЃЈMaximumЃЉЁЂБъзМЦЋВюЃЈStd. DeviationЃЉКЭ90%ЪТЮёЃЈ90 PercentЃЉЕШЯрЙиаХЯЂФкШнЃЌетаЉЪ§жЕДњБэЪВУДЃПгжЪЧдѕбљЕУРДЕФФиЃП

ЁЁЁЁ6.15.1 ЙигкЗжЮіИХвЊЪТЮёЯрЙиаХЯЂЮЪЬтЬсГі

ЁЁЁЁОЁЙмЮвУЧЖМЪЧадФмВтЪдЕФДгвЕШЫдБЃЌПЩЪЧзїЮЊВтЪдШЫдБЭЈГЃЖМгавЛИіЖдЪТЮяЁАЛГвЩЁБЕФаФРэЃЌдкетРяОЭБэЯжЮЊLoadRunnerИјГіЕФетИіНсЙћаХЯЂЪЧЗёПЩаХЃПвдМАЯргІЕФНсЙћаХЯЂЪЧШчКЮЕУЕНЕФЃП

ЁЁЁЁетШЗЪЕЪЧвЛИіКмКУЕФЮЪЬтЃЌЕЋЪЧЃЌШчКЮШЅжЄУїLoadRunner 11.0ЕФНсЙћаХЯЂЪЧе§ШЗЕФФиЃПДѓМвдкЦНЪБзіЙІФмВтЪдЕФЪБКђЃЌЪЧШчКЮжЄУїБЛВтЪдЕФЙІФмФЃПщЪЧе§ШЗЕФФиЃПЯраХзїЮЊВтЪдДгвЕепЃЌЮвУЧЖМЛсвьПкЭЌЩљЕиЫЕЃКЁАЮвУЧЖМЛсЩшМЦКмЖрВтЪдгУР§ЃЌгУР§АќРЈСНВПЗжЃКЪфШыКЭдЄЦкЕФЪфГіЃЌШчЙћИљОнВтЪдгУР§дкБЛВтЪдЕФЙІФмФЃПщЪфШыЯргІЕФЪ§ОнЃЌЪЕМЪжДааНсЙћКЭдЄЦкНсЙћвЛжТЃЌФЧУДОЭШЯЮЊДЫЙІФмФЃПщЪЧе§ШЗЕФЃЌЗёдђОЭЪЧЪЇАмЕФЁЃЁБЛиД№ЕУЗЧГЃКУЃЌФЧУДадФмВтЪдЪЧВЛЪЧПЩвдаЇЗТЙІФмВтЪдФиЃПЛиД№ЪЧПЯЖЈЕФЃЌЮЊСЫбщжЄадФмВтЪдЕФжДааНсЙћЕФе§ШЗадКЭИїИіНсЙћаХЯЂЕФЪ§ОнРДдДЃЌЮвУЧвВашвЊЪТЯШзщжЏвЛаЉЪ§ОнЃЌШЛКѓИљОнетаЉЪ§ОнЕФФкШнЫуГідЄЦкЕФНсЙћЃЌдйЭЈЙ§LoadRunner 11.0ШЅЪЕЯжЮвУЧЕФЯыЗЈЃЌЙлВьзюКѓжДааЕФНсЙћЪЧЗёКЭЮвУЧдЄЦкЕФвЛжТЃЌЕБШЛЃЌШчЙћвЛжТОЭЪЧе§ШЗЕФСЫЃЌВЛвЛжТЃЌЕБШЛОЭжЄУїСНепжЎМфгавЛИіЪЧДэЮѓЕФЃЌНсКЯЮвУЧдЄЦкЕФЩшЖЈРДНВЃЌЕБШЛЪЧLoadRunner 11.0ЪЧДэЮѓЕФЁЃ

ЁЁЁЁ6.15.2 ЙигкНсЙћИХвЊЪТЮёЯрЙиаХЯЂЮЪЬтЗжЮі

ЁЁЁЁетРяЮвгавЛИіЯыЗЈОЭЪЧЃЌЮвУЧЪТЯШзМБИ10ИіЪ§зжЃЌМДЃК1ЁЂ2ЁЂ3ЁЂ4ЁЂ5ЁЂ6ЁЂ7ЁЂ8ЁЂ9ЁЂ10ЃЌДгетзщЪ§зжЕБжаВЛФбЗЂЯжЃЌзюаЁЕФЪ§жЕгІИУЪЧ1ЃЌзюДѓЕФЪ§жЕгІИУЪЧ10ЃЌетаЉЪ§жЕЕФЦНОљжЕЮЊЃЈ1+2+3+4+5+6+7+8+9+10ЃЉ/10=55/10=6.5ЃЌдкетзщЪ§жЕРяБп90%ЕФЪ§жЕЖМЛсаЁгкЛђЕШгк9ЃЌжЛга1ИіЪ§жЕДѓгк9ЃЌМДЃКЪ§жЕ10ЁЃ

ЁЁЁЁвВаэЃЌДЯУїЕФЖСепХѓгбУЧвбОЯыЕНСЫЃЌЮвУЧЪЧЗёПЩвдНшжњLoadRunner 11.0ЕФЪТЮёКЭЫМПМЪБМфРДНЋЮвУЧЕФЯыЗЈЪЕЯжЁЃЁАрХЃЌШЗЪЕШчДЫЃЌЮвУЧЕФЯыЗЈВЛФБЖјКЯЁБЁЃ

ЁЁЁЁ6.15.3 ЙигкНсЙћИХвЊЪТЮёНХБОЩшМЦМАЦфЯрЙиЩшжУ

ЁЁЁЁЪзЯШЃЌЮвУЧПЩвддкVirtual User GeneratorжаБраДвЛИіНХБОЃЌМДЃК

| Action() { lr_start_transaction("ЫМПМЪБМфВтЪдЪТЮё"); lr_think_time(atoi(lr_eval_string("{thinktime}"))); lr_end_transaction("ЫМПМЪБМфВтЪдЪТЮё", LR_AUTO); return 0; } |

ЁЁЁЁЦфжаЃЌЁАthinktime.datЁБВЮЪ§ЛЏЮФМўФкШнАќРЈЪ§жЕ1ЕН10ЃЌЙВМЦ10ИіећЪ§жЕЃЌШчЭМ6-178ЫљЪОЁЃ

ЭМ6-178 ЁАthinktime.datЁБВЮЪ§ЛЏЮФМўФкШн

ЁЁЁЁШЛКѓЃЌЩшжУЁАthinktimeЁБВЮЪ§ЕФЁАSelect next row:ЁБЮЊЁАUniqueЁБЃЌЁАUpdate value on:ЁБЮЊЁАOnceЁБЁЃ

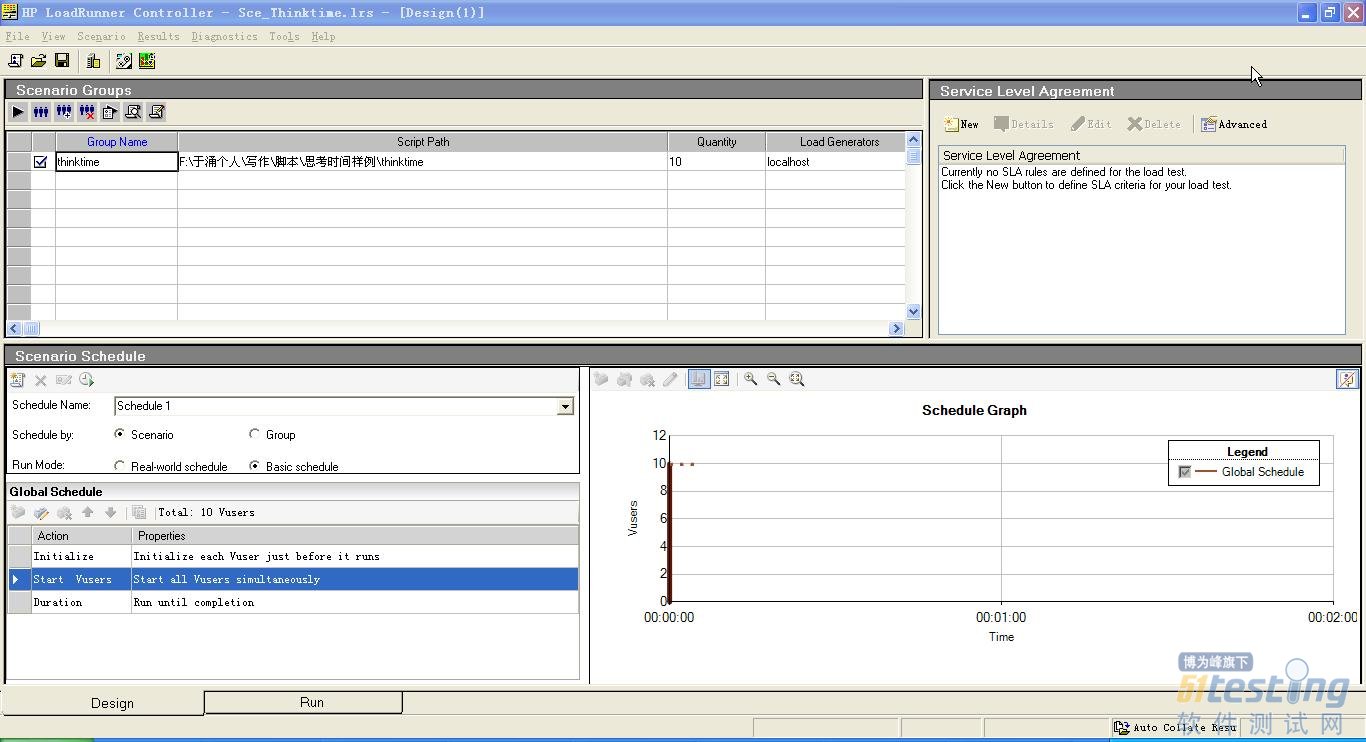

ЁЁЁЁНгЯТРДЃЌЦєЖЏЁАControllerЁБШУЮвУЧРДЩшЖЈвЛИіГЁОАЃЌЮвУЧдкВЮЪ§ЛЏЕФЪБКђвЛЙВВЮЪ§ЛЏСЫ10ЬѕЪ§ОнМЧТМЃЌдкГЁОАЩшМЦЕФЪБКђЃЌвВШЁ10ИіащФтгУЛЇЃЌШчЭМ6-179ЫљЪОЁЃ

ЭМ6-179 ЁАControllerЁБГЁОАЩшМЦЖдЛАПђ